Entretien avec François Weber, artisan développeur de logiciel de régie

“Je ne cherchais pas à être universel puisque je travaillais pour un spectacle.”

Depuis l’arrivée de l’informatique au théâtre, les pratiques de création et de régie ont considérablement changé. De nouvelles habitudes de travail se sont mises en place grâce à l’émergence de nouveaux outils et à leur détournement.

Beaucoup de professionnel.le.s font, dès les années 90, le constat que ces outils sont parfois inadaptés aux contraintes de la création pour le théâtre et qu’il faut trop souvent en contourner les limites. Quelques uns choisissent alors de concevoir leur propres logiciels, répondant à leurs questionnements sur leur pratique du son. Pour Silences Plateaux, quatre de ces développeurs indépendants ont accepté de raconter le chemin et les réflexions qui les ont mené à concevoir ces outils de création et de régie singuliers. Dominique Ehret et son Séquenceur d’Histoires, Olivier Sens avec Usine, Michel Zurcher pour RoseB et Francois Weber pour Axoa.

En posant l’idée que la créativité se développe en dehors des normes ou des standards, ces logiciels questionnent nos usages et nos outils, au moment où de nouveaux standards technologiques font leur apparition (notamment sur la spatialisation).

Ces quatre entretiens ont été réalisés en vue d’une conférence aux JTSE 2022, que vous pourrez retrouver prochainement en vidéo sur Silences Plateaux.

Francois Weber est un créateur de sons et d’images, par ailleurs co-responsable de la formation réalisation sonore à l’ENSATT, qui travaille pour le théâtre depuis 1987. Très vite, au grès de créations avec notamment Célie Pauthe, Didier Bezace, Cyril Hernandez… il questionne les outils avec lesquels il crée et fait le constat des limites qui lui sont imposées avec les technologies analogiques.

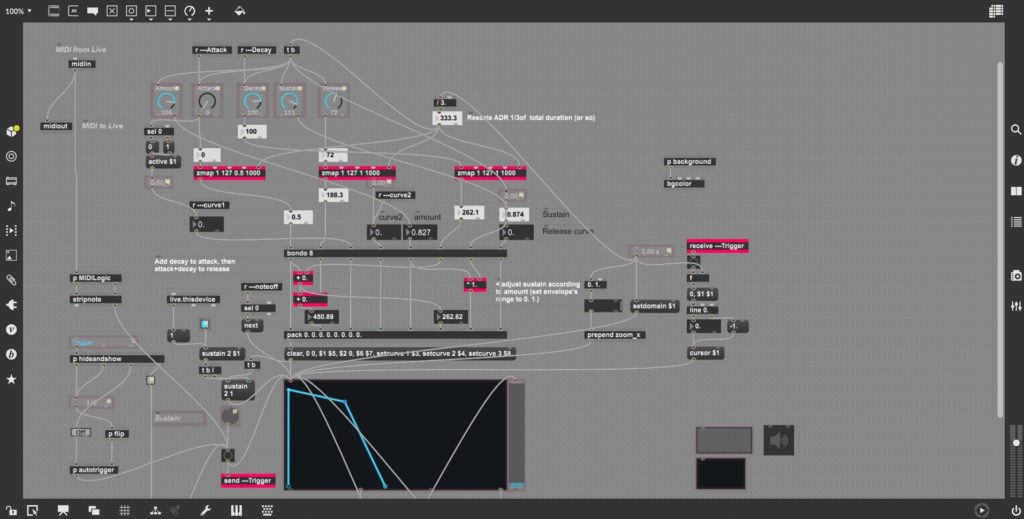

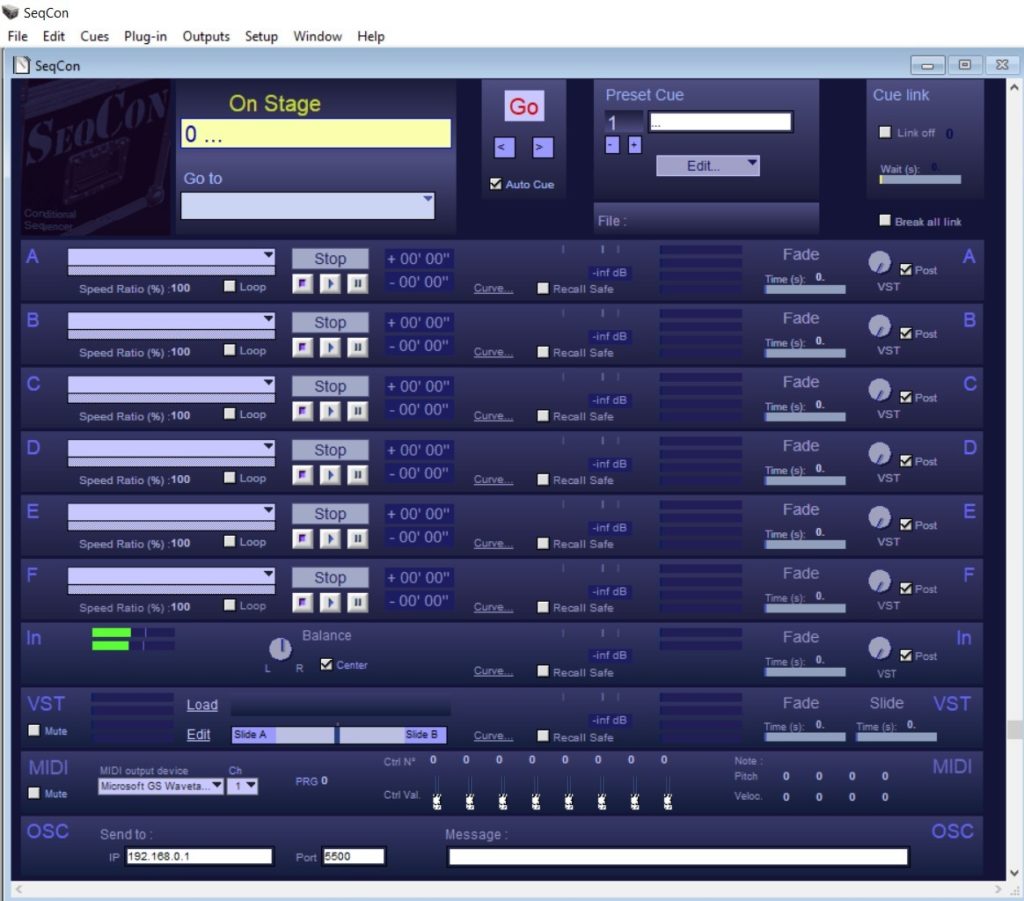

En se lançant alors dans le développement de ses propres outils numériques, avec l’arrivée de Max MSP, il devient l’un des pionniers en la matière aux cotés de quelques autres défricheurs. Après ses premiers patchs dans les années 90 , le SeqCon en 2000, il propose en 2022 un nouveau logiciel, AXOA, véritable couteau suisse de création sonore axé notamment sur les possibilités de diffusions multicanal.

Cet entretien a été réalisé par Antoine Richard et retranscrit par Loïc Leroux

Antoine : Comment travaillais-tu avant d’utiliser des outils de développement ? C’était quoi ta pratique avant la découverte de Max ?

François : J’ai commencé à travailler sous Max fin des années 80, début 90. J’ai commencé à une époque où il n’y avait pas d’outils informatiques. On a commencé à faire du son sous Max en 97. Les premières cartes son sont arrivées au début des années 90. Les premières régies que j’ai faite c’était avec des Revox. Très vite après il y a eu la gravure du CD, les Minidiscs etc.

MSP, la bibliothèque audio de Max, c’est arrivé en 97. Avant, dans Max on ne faisait pas de son. On faisait du MIDI mais il n’y avait pas d’audio. Il n’y avait pas de traitement du signal. Avec l’arrivée de MSP, j’ai tout de suite vu que ça pouvait être un outil pour moi.

A : Tu as tout de suite mis en places tes propres outils informatiques ?

F : Oui. Mais si tu veux il n’y avait rien à l’époque. Enfin il y avait Cubase audio, et l’ancêtre de Protools. C’était des séquenceurs, on travaillait en quatre pistes. La première carte son que j’ai achetée, elle était stéréo. Je me souviens aussi quand j’ai acheté un disque dur, je l’avais payé 7000 Francs, plus de 1000€ ! Et il faisait 500 Mo… J’étais super content parce qu’on pouvait presque mettre un CD dessus (rires). J’avais vachement de place quoi ! Et je l’avais payé 7000 F.

Pour en venir à la question qui nous intéresse, il y a deux choses : il y a la conception de l’outil et la distribution. Pour moi c’est vraiment deux choses différentes. Très vite j’ai commencé pour moi, pour les créations sur lesquelles je travaillais. À chaque fois je faisais des choses très spécifiques. Je ne cherchais pas à être universel puisque je travaillais pour un spectacle.

A : Qu’est-ce qui t’a manqué dans les outils existants ? Qu’est-ce que tu as vu comme potentiel dans les outils informatiques qui t’a décidé à te lancer dans le développement ?

F : La notion de mémoire, le fait de pouvoir mémoriser des choses. C’est-à-dire qu’avant il fallait recaler les CDs etc. Tout ce qui pouvait me permettre de libérer ce qui était de l’ordre de la manipulation technique.

Si on parle de Axoa [logiciel développé par François Weber, ndlr], c’est sur la spatialisation. Mais avant la spatialisation, le fait même de penser du Matriçage c’était quelque chose d’assez limité avec une console si on voulait penser la distribution sur plusieurs enceintes. On s’aperçoit que c’est assez compliqué de recopier les tranches, etc.

Très vite, je me suis aperçu que je n’avais plus besoin de console, puisque le gros de la console, c’est du routage. Et si le routage se fait de manière informatique, alors j’ai besoin d’une surface de contrôle, plus que d’une console. Alors effectivement la console je l’ai gardé longtemps, ne serait-ce que pour les traitements. Au début de MSP, si tu voulais faire de la réverb, de l’équalisation, du routing etc, ma machine (mon ordinateur) elle se mettait à genoux. Donc pour ces raisons, j’ai quand même continué un travail informatique / console. Mais assez rapidement la console est devenue obsolète.

A : Comment c’était perçu ? Au début, j’imagine qu’il y avait une petite défiance face à l’informatique qui naissait. Mais aussi une défiance sur le fait de ne plus faire ces manipulations, lâcher quelque chose au niveau de la sensation du son…

F : La défiance elle n’est pas au niveau des artistes, des metteurs en scène ou des équipes artistiques avec lesquels je travaille. La défiance elle est chez les régisseurs avec qui je bossais et avec les équipes d’accueil. Cette méfiance, je la comprends, parce que l’informatique ça peut planter. Ces discours-là ne sont pas fous.

En même temps si tu regardes ce qu’il se passe dans la musique contemporaine, tu vois qu’il y a des concerts qui se font uniquement avec des ordinateurs. Donc ayant éprouvé Max et voyant que c’était solide, je n’ai pas vraiment hésité. Ça n’a pas été un vrai problème.

Dans cette défiance-là, il y a aussi la peur de ne pas pouvoir être indépendant. Autant en analogique ou avec des logiciels simplistes, le régisseur il est à l’aise. Mais si on passe sur quelque chose de plus complexe, la question de la formation, de « est-ce que je serai capable de, en cas de problème, de comprendre ce qui se passe ? »… ça c’était une méfiance compliquée. Donc on est passé par des étapes.

Quand je parlais de supprimer la console, on en avait quand même une en parallèle. C’est-à-dire qu’on pouvait ou faire le travail à la console, ou sur l’ordinateur, selon les régisseurs. Les deux configurations étaient possibles. C’était comme ils voulaient. Et puis petit à petit on s’aperçoit qu’on utilise plus la console. En backup il y avait quand même les CDs : on faisait des CDs de secours avec une ou deux platines, au cas où. Moi j’ai fait ça pendant un moment et puis j’ai arrêté parce que les CDs ne m’ont jamais servi.

Honnêtement j’ai eu un problème informatique une fois. C’était au Rond-Point. Je voulais être en salle et le DT de l’époque n’a pas voulu. Je ne sais pas si tu connais la régie, mais on n’entend rien. Moi j’avais des micros, donc j’ai négocié de pouvoir être sur le plafond de la salle. J’étais plus en hauteur, mais j’étais dans le même espace acoustique et pas dans une régie où on n’entendait rien. J’étais coincé sur la passerelle, et à un moment j’ai mis le genou sur le clavier. Je ne sais pas ce qui s’est passé, mais le Mac a craqué ! C’est le seul problème informatique que j’ai eu depuis que je travaille avec Max. Donc je ne suis pas inquiet.

C’est vrai que je passai mon temps à expliquer que, non, il n’y avait pas de problème aux régisseurs qui m’ont accueilli. Aujourd’hui ce n’est plus le cas, au contraire. Je pense à Momo, Nicolas Dubois, qui est le régisseur avec qui je travaille pas mal ; quand il arrive en tournée avec ces outils, tout le monde est curieux, lui pose des questions « comment tu fais ça et ça ? Ah ! C’est génial… »

A : Tu parlais du moment où tu as commencé à concevoir de petits outils… Ça a été le début de la réflexion sur un outil plus général ?

F : Avant l’informatique, je me posais déjà ces questions-là, comme n’importe quelle personne faisant du son. Par exemple, si je veux faire un déplacement sur trois enceintes, comment je fais ? J’ai ma console, je vais affecter cette tranche dans cette sortie… Quand je suis en tournée je m’aperçois que les consoles ne sont pas les mêmes, les faders ne réagissent pas de la même manière… donc je suis obligé de répéter ce même mouvement. Je ne sais pas si tu as connu ça, mais moi je répétais le mouvement que j’avais à faire le soir, un peu comme un musicien qui arriverait et qui teste son instrument.

Au bout d’un moment tu te poses des questions. Tu te dis qu’il y a une réflexion à avoir au niveau de l’outil. Ça s’est développé en même temps que je fabriquais, il n’y a pas un moment où je me suis dit «je réfléchis à l’outil et je le fabrique »

Max est conçu pour ça : les choix que je fais au niveau du développement ont des conséquences sur ma pratique. Ma pratique va influencer mon développement. C’est entremêlé. Ce questionnement sur les outils c’est aussi un questionnement sur ma pratique : Comment je mets en jeu ? Qu’est-ce que je fais comme choix ? Qu’est-ce que je donne à entendre et comment je le donne à entendre ?

Les premières moutures, c’était le SeqCon (contraction de Séquenceur Conditionnel, ndlr) . Au début je ne développais que pour moi, mais très vite, notamment au festival d’Avignon, des gens qui font du son pour le théâtre me disaient « je fais ça, tu pourrais pas me faire un petit patch? » Donc je faisais un petit patch. A l’époque, la demande c’était surtout d’émuler les platines CD. C’est ce que fait avec le Seqon : des lecteurs qui partent dans un matriçage. C’est très limité en termes de traitements, de spatialisation. C’est un outil que j’ai fait pour des copains, en me disant « j’ai fait ça, je le mets en ligne, ceux qui veulent le prennent » et puis voilà quoi.

Ça tombe au moment où Dominique Ehret a fait le Séquenceur d’Histoire et le SH. A l’époque, il ne traitait pas le signal audio. Il ne faisait que prendre la main sur une console. Ça permettait de piloter la 02R des mémoires d’automation. C’était assez souple et assez synchro, mais il n’avait pas de moteur audio. Moi, je proposais un outil avec des moteurs audio et du matriçage, donc on était…

A : Presque complémentaires ?

F : On aurait pu être complémentaire si on avait réussi à trouver une voie dans le développement. Je ne veux pas rentrer dans les détails ni faire polémique, ce n’est pas le lieu, mais j’ai choisi la distribution gratuite et Dominique Ehret a plutôt choisi une distribution commerciale.

A : Ce n’est pas que le choix de l’argent, c’est aussi un choix philosophique de partage des outils…

F : Au début, je l’ai fait pour répondre aux demandes de copains, donc je ne leur ai pas demandé du fric pour leur filer un truc. Quand ils me rendent un service, ou quand je leur demande un truc, ils me répondent et il n’y a pas de facturation. C’était l’esprit au départ.

Ensuite, je me suis posé la question. Sur les premières versions je demandais 30€ et jamais personne ne m’a donné 30€. Plusieurs me l’ont proposé, mais j’ai refusé. Parce que, à partir du moment où j’accepte de l’argent, quelque soit le prix, je dois un service au-delà de ce que je donne. Si je mets en ligne un truc et que je le donne, tu le prends, tu l’utilises, et c’est plus mon problème. Si je demande de l’argent, je dois de la maintenance, de la formation, de la documentation… et c’est normal. Si je continue le développement, dans ce cas-là, il faut que je me structure et que je dégage du temps pour ça. C’est le choix qu’ont fait Dominique Ehret ou Nicolas Batz (D:light). C’est tout à fait respectable, mais moi je n’ai pas voulu faire ça. Je ne veux pas aller sur ce terrain-là, c’est pas mon métier. Je veux continuer à faire du son, pas de l’informatique.

Petit détail, le SeqCon, je ne m’en suis jamais servi ! J’ai continué à travailler de manière spécifique pour chaque spectacle.

A : C’est intéressant le point de bascule entre toi, créateur sonore, et cet usage que tu as du développement pour tes propres outils. Quand tu as commencé à développer le SeqCon, destiné à être donné, comment tu l’as détaché ta propre pratique, qui est de construire à chaque fois l’outil dont tu as besoin ?

F : Le SeqCon, c’est simple : je l’ai mis en ligne, j’ai fait une mise à jour, et je n’y ai pas touché pendant 20 ans. Il est toujours en ligne, quelque part sur un site… Mais je n’y ai pas touché parce que ça ne correspondait pas à ce que moi je faisais. J’ai continué à intégrer des éléments de spatialisation, de traitements… Beaucoup de choses qu’on retrouve dans Axoa aujourd’hui.

A : Pour Axoa, c’est le même processus ?

F : Axoa, c’est différent. Faisant de moins en moins de tournées, je passe de plus en plus la main à des régisseurs. A chaque fois que je passe une régie, j’essaie de faire en sorte que le régisseur soit à l’aise avec l’outil. J’ai pas envie de mettre quelqu’un en danger parce que moi, j’ai décidé que pour charger un fichier son, il faut appuyer sur la touche machin et machin… J’essaye de faire quelque chose qui soit fonctionnel.

Alors de création en création, je me suis dit : « pourquoi pas finalisé un outil qui me convienne avec lequel le régisseur va pouvoir s’habituer au fil des créations ». Je me suis dit « il faut que je formalise un outil pour qu’avec les régisseurs qui prennent le relais derrière moi, quelque part il y ait une fidélisation, qu’ils soient à l’aise. Que d’un spectacle à l’autre ils n’hésitent pas à faire des modifications de conduite, etc. »

Axoa est plutôt dans cet esprit là. J’ai regroupé un peu ce que j’utilisais dans mes diverses pratiques, les vsti (instruments virtuels), on peut charger un sampleur, il y a des entrées micro. Et puis il y a trois moteurs de spatialisation. Le premier c’est du matriçage standard, comme avec une console, le deuxième c’est le DBAP et le troisième c’est l’HOA. Trois approches très différentes de mise en espace d’éléments sonores. Et ça c’est quelque chose que j’ai choisi en fonction de… enfin ça goûte pas pareil.

A : C’est l’aboutissement de quelque chose de ta pratique avant d’être un outil ?

F : Après on s’aperçoit que pour le formaliser, pour qu’il devienne un peu « universel », ça pose des questions que moi je ne me suis jamais posées. Dès que tu le mets dans les pattes des régisseurs, ils voient les limites de l’outil. C’est intéressant d’avoir des retours utilisateurs parce que ça me permet d’adapter et de faire des mises à jour.

A : C’est une question que je voulais te poser. Moi je suis plutôt utilisateur de Live. C’est un outil que j’ai l’impression de contourner en permanence, de pousser dans ses limites, et ça a du sens que le logiciel ait ses limites pour que je puisse les contourner.

F : Je fais juste une parenthèse sur Live, que je connais un petit peu. Moins bien que toi parce que je ne suis pas un praticien. Moi, ça m’a fortement renvoyé à la question de l’outil. C’est-à-dire que l’outil conditionne la pensée. Si je ne peux travailler qu’en stéréo, que mon moteur est stéréo, si mes outils de prise de son sont stéréo, au final je pense en stéréo. Et la question de l’espace ce serait quelque chose que je fais en plus. Je vais « mettre un petit plus d’espace ».

Alors que si je pense dans l’espace la prise de son, si je pense dans l’espace ma diffusion, ma pensée est différente. Je ne pense plus en stéréo que j’élargis, je pense en espace. Là je suis en train de travailler sur un projet [… il montre 2 hp derrière lui], là tu vois deux enceintes mais en fait j’en ai huit autour de moi. Je travaille sur huit points. Ma copine elle écoute beaucoup de chansons, et j’ai réécouté des mixages stéréo, et d’un coup ça me paraît plat ! (rires).

Robert Normandeau, c’est un musicien et pédagogue canadien, qui a installé un dôme pour ses élèves à l’université. Lui, il dit que l’espace ce n’est pas une épice qu’on rajoute dans un plat. C’est vraiment le fondement de l’écriture qui doit se faire dans l’espace. Ça, Live ou tous les logiciels de montage ne le permettent pas. Alors c’est en train de changer, ProTools, Nuendo, tous ces outils-là commencent à travailler en ambisonique. Il y a l’Atmos etc, on commence à avoir une pensée autre que la stéréo. Mais Live pour moi, c’est un carcan terrible.

A : Pour toi Axoa à qui il se destine ? Quelle place prend-il dans un processus de travail ?

F : C’est une très bonne question. Quand tu commences à travailler sur l’espace, il y a des outils de diffusion, mais pour l’instant les outils pour la production sonore dans l’espace sont assez maigres. Ta question, elle me renvoie à ça. C’est plus complexe que ça, parce que l’écriture de son elle se fait sur le plateau. Même si je peux préparer des sons etc, c’est sur le plateau que ça s’écrit et que ça se compose.

Axoa c’est un outil où je peux très rapidement mettre en jeu des sons dans l’espace. Un son, je veux le déplacer, boum boum, une matière et très vite je vais pouvoir la positionner, la tordre. C’est un outil qui, en temps réel, me permet de travailler assez rapidement. C’est aussi un outil qui, notamment avec le lecteur Ambisonique, me permet de travailler en studio ou chez moi. Ça me permet de composer à la maison, des espaces que je vais pouvoir adapter et donner à entendre sur le plateau. Quel que soit le nombre d’enceintes. Il n’y a plus de lien entre la position des enceintes et l’espace qu’on fabrique.

Là par exemple je travaille sur huit HP, mais sur le prochain spectacle je sais que j’aurais au moins 12 enceintes, Je ne sais pas comment elles vont être placées, mais je sais que je retrouverai une cohérence dans l’espace. Je peux déjà écrire comme ça, je vais bouncer en HOA en ordre 3, donc en 16 canaux ambisoniques, et ensuite je sais qu’ils seront décodés sur les enceintes qu’il y aura.

Ça me permet un travail sur l’espace en dehors du plateau que je vais pouvoir retrouver. Ça ne sera pas la même chose évidemment, mais je vais retrouver quelque chose de cohérent. Et puis l’écriture du plateau avec les interprètes, elle peut se faire immédiatement. Peu importe, si je veux mettre un son ici ou là, c’est immédiat. Et si je veux avoir un déplacement de son, un traitement, c’est immédiat aussi. J’ai une souplesse dans la mise en jeu.

Et surtout, ce que je ne retrouve pas avec Live, c’est cette notion de mémoire. Je ne peux pas faire de mémoire dans live. Je suis obligé de faire des colonnes et des colonnes et des colonnes et des lignes et des lignes et des lignes et des lignes… Alors que là, je fais un truc, tac tac, ok je le garde, je l’enregistre, pouf, je l’appelle toto.1 ou Acte2 scène3 essai#2… C’est dans la boîte quoi. Si je veux le reprendre je vais le retrouver.

A : Quelque chose qui va se déployer dans tout l’espace tient dans une petite boîte avec un nom, alors qu’avec Live on va se retrouver avec des choses plus complexes… Sur Live, ce que j’aime c’est d’avoir un « tableau » dans lequel je vois tous mes sons. Ça donne une matérialité à l’ensemble de la création que je trouve très différente d’autres logiciels. C’est quelque chose à quoi tu avais réfléchi ?

F : Sur Live, tu vois tous les sons passés et à venir. Est-ce que tu as besoin de ça ?

Moi j’ai besoin d’avoir des informations sur ce qui est en train de se passer. Pouvoir voir mes différents vumètres, sur toutes mes entrées, ça c’est un vrai besoin. Qu’est-ce qui se passe en ce moment et comment je peux le modifier.

Pour la question des mémoires, je fais souvent le parallèle avec les jeux d’orgue. Live ou Millumin, c’est exactement la même chose, c’est la même pensée qui est derrière. Imagine que tu dises à un éclairagiste « Alors voilà, maintenant l’outil que tu vas prendre pour faire une création, c’est un jeu d’orgue, mais tu n’as pas de mémoire. Tu as des groupes, tu peux prendre autant de groupes que tu veux, tu vas pouvoir passer d’un groupe à l’autre, mais tu ne fais pas de mémoire » À ton avis, combien d’éclairagistes vont accepter cet outil-là ? Il y a quelque chose de vraiment bancal là-dedans. Ça fait partie de ma pratique, je ne critique pas. Je sais que Live est utilisé par 95 % des gens qui font du théâtre en France.

C’est aussi très français, live. À l’étranger c’est plutôt Qlab. J’ai vu l’histoire de Live en France, c’est intéressant. Pourquoi Live a explosé en France ? Live, au départ, a été créé avec Max. Et Live, à un moment donné, a été distribué par SCV, un distributeur qui n’existe plus. Ils avaient un réseau de distribution dans le théâtre qui était énorme, c’est ce qui explique, en partie, pourquoi on le retrouve beaucoup en France.

A : Je me rends pas compte de l’envergure du développement de Live, mais le fait que ce soit très utilisé par les musiciens avec qui on peut se retrouver à travailler, il y a un confort lié à la pratique de la musique au théâtre.

F : À chaque fois que je bosse avec des musiciens, je ne suis pas du tout au même endroit qu’eux. Ça m’intéresse que nos outils communiquent, ce qui, avec Max n’est pas un problème parce que je ne vois pas avec quoi Max ne pourrait pas communiquer. Mais on n’est pas au même endroit. Ça ne veut pas dire que je ne suis pas à l’endroit de la musique. Il y a des fois où je vais faire de la musique, je vais même composer, dans certains spectacles c’est arrivé. C’est un peu comme quand je fais de la vidéo avec un plasticien ou avec un graphiste, Je ne vais pas aller sur ce terrain-là. Je préfère qu’on travaille ensemble et qu’on se retrouve sur des questions qui nous sont propres, plutôt que d’essayer de grignoter du côté de la musique.

A : Je voulais revenir sur ce que tu disais de l’endroit où Axoa intervient dans la création. Tu pars de quelque chose qui commence dès la fabrication des sons ?

F : Dès le premier jour, dès la première répétition, dès qu’on commence à mettre du son en jeu, c’est avec Axoa. Il suffit d’avoir des enceintes et hop tu envoies du son dessus. C’est immédiat, tout de suite tu peux commencer à faire des mémoires. C’est un outil en temps réel qui fonctionne. Petit à petit, la conduite elle va se construire, s’affiner de répétitions en répétitions. Il n’y a pas d’étape où on se dit qu’on va recopier la conduite, c’est le même outil qu’on utilise sur la création et sur la tournée. Même en tournée on peut continuer à modifier les choses.

« Axoa (prononcé Achoa) c’est un jeu de mot entre HOA High Order Ambisonic et Axoa un nom basque. C’est un plat très bon, un petit émincé de veau au piment d’Espelette. »

A : Quand tu travailles avec, il y a un régisseur qui arrive dès le début ?

F : J’aimerais pouvoir travailler en binôme le plus rapidement possible, mais évidemment il n’y a pas le budget pour ça. Le régisseur nous rejoint en fin de création. Et puis, il faut qu’il prenne la main rapidement sur la conduite qu’il comprenne tout de suite.

C’est une vraie question pour moi, la régie. Ce qui m’intéresse, c’est d’automatiser au maximum ce qui est chiant et contraignant. Par contre dès qu’il s’agit de la mise en jeu, j’aime bien garder de la souplesse, j’aime bien considérer le régisseur comme un interprète. Il y a quelque chose qui est de l’ordre du vivant. Du coup la question de la transmission de la régie, elle est compliquée.

Je me souviens, sur un spectacle d’avoir insisté pour que le régisseur suive dix dates (en fait, il en a fait cinq ou six). Pour qu’on soit en binôme sur le début de la tournée. Qu’on ne fasse pas « bon ben alors on a deux jours de reprise, tu reprends la régie et voilà, quand il dit « bonjour » c’est boum, quand il lève le bras tu appuies ».

Ce que je voulais transmettre c’était les intentions. Ce n’était pas « tu as un repère au texte et tu montes de 20db ». Je m’en fous, je ne sais pas de combien je monte, je fais au feeling. Et je veux que tu comprennes le sens qu’a le son ou le filtre. Je veux que tu comprennes le sens de ce qu’il se passe. Après tu t’en empares et c’est toi qui va raconter. Ça demande du temps en filage, en jeu. Pendant cinq ou six dates, c’est des défraiements, des déplacements, ça a un coût. Mais la metteur en scène a accepté. C’était un spectacle où il y avait beaucoup de son. Elle a bien compris où était l’enjeu. Elle a bien compris que s’il fallait changer l’interprète, le coût ne serait pas le même que si on change juste un pousse-bouton. J’essaye de transmettre au régisseur, non pas une conduite précise, mais des intentions de jeu. Qu’il comprenne à quoi servent les sons et pourquoi ces sons sont là à un moment donné. Et après à lui de se débrouiller avec ça.

C’est drôle parce que les fois où je retourne voir un spectacle, je comprends que ce n’est pas exactement ce que j’avais pensé. Mais c’est juste. C’est juste parce que le régisseur s’est approprié le truc, avec les interprètes, que ça a bougé. Ce n’est pas ce que, moi, j’aurais fait, mais c’est juste dans le propos. L’intention que je voulais donner elle était là. Des fois c’est un peu fort, des fois c’est un peu ci, c’est un peu là. Mais c’est pas grave parce que c’est juste. C’est ça qui m’intéresse.

A : Ça veut dire que dans la manière dont tu as pensé le logiciel, tu as la possibilité de reprendre la main sur beaucoup de paramètres ?

F : Sur tous. Tous les paramètres, que ce soit la spatialisation, le mouvement, le machin, le truc, si tu prends la main, l’automation s’arrête. Si il y a un temps d’entrée, un fade in, dès que tu touches le fader et que tu rejoins la valeur, l’automation s’arrête et c’est la main qui est prioritaire. Toujours, toujours, toujours. Tous les paramètres qui sont en mouvement, sur lesquels il y a une temporalité, c’est la main qui est prioritaire.

A : Ce qui est assez beau dans ce logiciel, et qui manque dans pas mal d’autres, c’est la possibilité d’enregistrer des mouvements complexes. Typiquement toute une spatialisation. Et ce qu’on va retrouver ce n’est pas une ligne d’automation tracée à la souris, c’est quelque chose qu’on a tracé de manière sensible sur un instant. C’est marrant parce qu’il y a quelque chose qui se tisse de l’avant-informatique. Garder les faders sous les doigts, garder le contrôle, garder un feeling avec le plateau…

F : Il y a des spectacles dans lesquels mes mémoires ne servent qu’à charger mes sons dans le lecteur, et même pas à les déclencher. Je sais que sur ma mémoire tant, à cet endroit, j’ai ce son, à cet endroit j’ai ce son, et on va pouvoir les jouer comme ça. Tout se fait à la main : les déclenchements, les passages en lecture, les arrêts… Tout se fait à la main quoi.

Le régisseur il a le temps, il n’a rien d’autres à faire pendant le spectacle. (Rires) autant en profiter !

A : Quand tu vas charger une mémoire dans laquelle tu as quatre sons, tu vas pouvoir travailler avec les contrôleurs de ton choix ? Par exemple 4 fadeurs pour des volumes, un joystick pour la spatialisation ? Et dans la mémoire d’après, reconfigurer et choisir ce que tu as sous la main ?

F : C’est exactement ça. Même les passages en lecture dans mon travail ils ne sont pas automatisés. Les play se font à la main sur la surface de contrôle.

A : Sauf si tu as besoin d’un déclenchement très précis j’imagine ?

F : Ça arrive que tu veuilles que ce son parte en même temps que l’autre s’arrête, des événements… mais ce n’est pas la majorité, ce n’est pas ce qu’on trouve le plus dans une conduite de théâtre.

A : Qui s’en sert en dehors de toi ? Tu as des retours ?

F : C’est aussi une question sur la distribution, le fait de mettre en ligne, si personne ne le sait, personne ne va l’utiliser. Je n’ai pas fait de travail dans ce sens-là.

Olivier René a fait 3, 4 spectacles avec. Il travaille beaucoup avec des musiciens, il utilise pas mal les entrées micros. Mateo, un ancien élève, qui m’a appelé il y a deux jours, il est sur un festival et il l’a donné à plein de compagnies qui n’ont pas de régisseur son. Il m’a renvoyé qu’une metteur en scène avait fait une super conduite. Elle ne fait pas de son, elle connait pas la régie son. Elle a fait de l’espace, du mouvement, elle a enregistré des trucs. Le principe est assez simple. Momo, le régisseur avec qui je bosse s’en sert aussi. Je crois que c’est à peu près tout.

Je ne piste pas les gens qui téléchargent, mais je sais qu’il y a plusieurs gigas de téléchargés chaque mois. Après ce n’est pas parce que tu télécharges que tu l’utilise donc je n’en sais rien. Depuis le Seqon, je crois qu’il y a une centaine de spectacles qui ont été fait avec mais honnêtement, je m’en fous! (Rires) Je n’ai jamais mis de moyens en place pour le savoir.

A : Toi, en tant que développeur, la satisfaction que tu peux avoir à partager cela, c’est quoi ?

F : Ça marche ! C’est fiable et on peut s’en servir. Quelque part, ce que tu en fais, ça t’appartient. C’est aussi pour ça que c’est gratuit. J’ai mis un truc en ligne, prenez-le, allez-y, amusez-vous, faites-moi des retours si vous voulez mais il n’y a rien d’obligatoire.

A : Tu parlais de la formation, d’expliquer comment ça fonctionne…

F : C’est une vraie question. On parlait d’ambisonique. Il y peu de régisseurs son qui font du théâtre qui connaissent le principe de l’ambisonique. Même ceux qui travaillent sur l’espace, cette notion d’ambisonique, où il faut encoder puis décoder, c’est des fois pas très clair. Donc j’essaie de répondre aux questions, de donner des éléments…

Le régisseur avec qui je travaille, l’ambisonique ça ne lui disait rien. Et j’ai aussi pensé l’outil pour lui, c’est à dire qu’en 1h, si je lui explique, il comprend et il est capable de l’expliquer à un autre régisseur. Donc l’interface, il faut qu’elle soit assez simple. Simple sans être simpliste, c’est ça qui est compliqué. Il faut pouvoir faire des choses complexes simplement. Ça, c’est pas évident, c’est un vrai métier.

A : Ça renvoie à ce que tu disais : la complexité d’une interface va peut-être fermer ta capacité à rêver le son que tu es en train de produire.

F : C’est ce que j’apprécie dans Max. Si je veux aller dans de la complexité, je peux, si je veux simplifier, je peux. On parlait de formation, il faudrait que tous les régisseurs soient formés sur Max ! (Rires) Quel est le niveau de complexité… c’est compliqué, ça. On voit bien que l’utilisation d’un outil influence la pensée. Donc si tu peux avoir un outil malléable, modulable, forcément ça te renvoie à ta pratique et à ta pensée.

Pour Axoa, j’ai essayé de faire des choix… Par exemple, l’idée, c’est d’avoir une seule page. Pendant le spectacle, il ne faut pas que le régisseur ouvre 36 000 fenêtres. Il y a tout sauf les entrées micros, donc j’ai rajouté une fenêtre pour les visualiser, à la demande de Matéo Esnault. Et lui, il a développé quelques parties, quelques petits trucs dans Axoa.

Ça, c’est quelque chose que j’aime. L’idée c’est pas de porter, moi, cocorico, j’ai fait ça avec mes petits bras musclés, mais que le développement puisse continuer. J’ai donné les patchs à Matéo, il en a modifié certains. Il y a certaines mises à jour qui ont été faites parce que Mateo a mis les mains dedans.

A : Tu as introduit, consciemment ou pas, une dimension expérimentale et pédagogique sur des nouvelles manières techniques de penser une création sonore ?

F : Pédagogique, oui. Je suis enseignant.

Mais je ne dirai pas nouveau. L’ambisonique ça date des années 70. Le DBAP, ça fait 20 ans que je l’utilise dans mes créations. Je préfère le terme de recherche, c’est à chaque fois un questionnement sur un petit truc qui va avoir des conséquences sur la manière dont ça évolue globalement. Plutôt que l’idée de nouveauté, je pense plutôt au work in progress, la recherche en permanence.

A : Comment imagines-tu l’avenir ? Sur Axoa, tu as un peu répondu en disant que ça pouvait s’enrichir de la participation d’autres développeurs… D’une manière plus large, je sais que tu participes à des groupes de réflexion autour de l’informatique et des outils de régie. Comment tu aimerais que les choses évoluent ?

F : J’ai une crainte, c’est la normalisation et que l’on arrive à des formats rigides. On a parlé de Michel Zurcher, Dominique Ehret, Olivier Sens, c’est des approches très différentes et c’est bien qu’il y ait cette diversité [cf : articles Silences Plateaux]. Live en est une. C’est pas le choix que je fais moi, mais c’est pas grave. Ce qui me fait peur, c’est la normalisation qu’il risque d’y avoir avec la spatialisation.

A : Est-ce que ce n’est pas lié aux lieux de représentation. Il y a peu de compagnies qui vont avoir les moyens de tourner avec beaucoup d’enceintes ou un système complexe de spatialisation…

F : Non, c’est pas vrai. Par exemple je suis en train de me faire un petit kit : j’ai 12 enceintes, c’est des MSP5, d’occasion, tu trouves ça à 150€. On trouve neuves des petites enceintes à 80€. (Il montre un HP). Ça, ça fait 50W, ça ne descend pas très bas, ça sonne moyen mais ça coute 80€ ttc. 10, ça fait 800€. Axoa, c’est gratuit. Les coûts sont en train de baisser.

Les fabricants comme Nexo, D&B, L-acoustics etc, proposent des solutions à 10 000, 20 000, 30 000€ qui ne sont pas fonctionnelles pour des compagnies ou des petites structures, mais il y a des alternatives à ça. On peut aujourd’hui avoir des partis pris comme ça, une pensée sur l’espace pour de faibles coûts.

A : Outre les prix élevés, qu’est ce qui t’inquiete dans les solutions proposées par ces fabricants ?

F : La normalisation des formats de spatialisation.

Par exemple l’ADM, ça vient du cinéma. Tu ne peux pas bouger les enceintes dans chaque salle. Elles sont en Dolby, en THX… Donc ils ont trouvé un système pour que les bandes sons soient compatibles dans toutes les salles : mixer en objet. Sur ta piste, tu enregistres le niveau et un déplacement sur x, y et z. Ensuite, dans la salle de diffusion, tu as un décodeur qui va décoder ça et le diffuser sur le système de la salle quel qu’il soit.

Tous les fabricants font des supers outils de spatialisation qui fonctionnent sur ce principe-là. On va rentrer des objets et bouger ces objets. Sauf que cette notion d’objet, je la trouve terrible. Elle est pauvre. Ça réduit le son à une piste qu’on va déplacer dans un xyz. L’espace est plus complexe que ça. Mon travail ambisonique, qu’est-ce que j’en fais ?

A : In fine, c’est aussi une esthétique. Ce n’est pas qu’une contrainte économique ou technique, c’est aussi une standardisation de comment ça sonne, de comment ça bouge.

F : J’ai dit mes craintes mais ce que je souhaite, c’est deux choses : Que le développement continue pour aller à des endroits qu’on ne soupçonne pas, mais qui sont motivés par la création, pas par le commerce ou je ne sais quel format. Et ensuite, qu’il y ait une diversité des approches. Je ne pense pas qu’il y ait une seule approche possible. Je pense vraiment que c’est dans la diversité que…

Tu vois, même moi dans Axoa, j’ai du mal à choisir entre le matriçage, le DBAP, l’ambisonique. Ça goûte pas pareil. Pourquoi en choisir un ?

A : Une dernière question : tous ces outils qui demandent un temps de mise en œuvre, de réflexion et de travail dans une création, c’est une différenciation entre les métiers de créateur et de régisseur ? Comment ces choses-là sont amenées à évoluer, avec la multiplication de ces outils ?

F : Moi, j’adore travailler avec un régisseur. Justement, ça me permet d’avoir mes oreilles disponibles pour le plateau. Mon esprit complètement sur le son et pas sur les manipulations. Après c’est compliqué pour deux raisons :

Des raisons économiques. Je ne suis pas devin mais je vois bien que les budgets de production s’amenuisent de plus en plus et que la technique, il faut que ça se réduise. Je pense qu’avoir deux personnes sur le son, c’est compliqué. De plus en plus le régisseur va faire la création, ou le créateur la régie. Je pense que ces deux métiers seront de plus en plus confondus. On sort du paradigme des années 80, 90 où il y avait le concepteur et le régisseur. Aujourd’hui, ça tend à se confondre.

Une autre raison, pour moi fondamentale, vient des écritures de plateau. Je le vois quand je travaille avec des jeunes compagnies, des trentenaires. On a plus le régisseur, la lumière, la vidéo, la scéno, le machin truc où tout le monde travaille dans son coin. Depuis le début, tous les intervenants sont là. On voit bien qu’une lumière va influencer un son, un son va influencer un élément de peinture du décor etc… ça fonctionne ensemble. Et pour que ça travaille ensemble, il y a des chances pour que le créateur son soit aux manettes. Sachant qu’un son, ce n’est pas neutre. Même une montée de fader, ce n’est pas neutre. Ça écrit aussi et ça fait partie du processus d’écriture. Donc jusqu’où on peut faire la différence entre le régisseur son et le créateur ? Pour moi, ce n’est pas simple et ce n’est pas résolu.

Pour télécharger et découvrir AXOA (qui est gratuit), rendez vous sur le site de Hapax

http://hapax84.free.fr/Axoa.html